🔎 Clickbait da tragédia

#217: Da enchente em Minas à guerra no Oriente Médio, posts exploram comoção com vídeos falsos e imagens fora de contexto

Oi, Luciana Corrêa, editora-chefe da Lupa, aqui. Na Lente de hoje a repórter Gabriela Soares mostra exemplos diferentes de um mesmo problema: o compartilhamento de imagens falsas em episódios extremos, como as recentes chuvas em Minas Gerais e, agora, a nova guerra dos Estados Unidos e Israel contra o Irã. Tem de tudo, o “roubo” de imagens para uso fora de contexto, criações feitas com IA para “vídeos ficcionais”, enfim, tudo vira desinformação nas redes sociais. Aproveite a leitura e repasse as dicas aos amigos e familiares para que ninguém caia na mentira. Boa sexta-feira por aí!

A tragédia que viraliza: quando catástrofes viram estratégia de engajamento

A imagem é comovente. Sob uma massa de escombros e lama, um homem aparece soterrado até o pescoço. Um bombeiro se inclina para ajudá-lo a sair. Ele pede que não. Diz que precisa ficar, pois segura as mãos das duas filhas, completamente soterradas pelo lamaçal e provavelmente sem vida.

A legenda que acompanha a imagem reforça o apelo: “MINAS GERAIS PEDE SOCORRO, JUIZ DE FORA ESTÁ NUMA SITUAÇÃO MUITO COMPLICADA!”.

De fato, a cidade vive dias devastadores. Desde 23 de fevereiro, o município enfrenta chuvas extremas, que provocaram deslizamentos, enchentes e deixaram um rastro de destruição na região. Fevereiro terminou como o mês mais chuvoso de Juiz de Fora desde 1961, com mais de 750 milímetros acumulados. Até esta quarta-feira (4), a tragédia já havia deixado 65 mortos e 8.584 pessoas entre desabrigadas e desalojadas.

Mas a cena do pai soterrado não tem qualquer relação com a tragédia mineira.

O registro faz parte do curta-metragem venezuelano Sofía y Daniela, lançado em 2007 e inspirado em outro desastre, o deslizamento que atingiu o estado de Vargas, próximo à Caracas, capital da Venezuela, em 1999. O homem sob os escombros é o ator Sebastián Torres.

Apesar de enganoso, o post — apagado pelo responsável após a verificação da Lupa — acumulou mais de 15 mil curtidas e centenas de comentários em apenas um dia, entre 25 e 26 de fevereiro.

Trata-se de uma estratégia de engajamento conhecida, já mostrada pela Lente antes: criar um factoide para capturar a comoção pública enquanto explora uma tragédia real. Em geral, a tática pode servir para monetização de contas, ao atrair visualizações e seguidores para, no futuro, haver conteúdos patrocinados ou venda de produtos.

Com as ferramentas de inteligência artificial, que facilitam a fabricação de histórias capazes de enganar e capturar a atenção nas redes sociais, essa estratégia se potencializa.

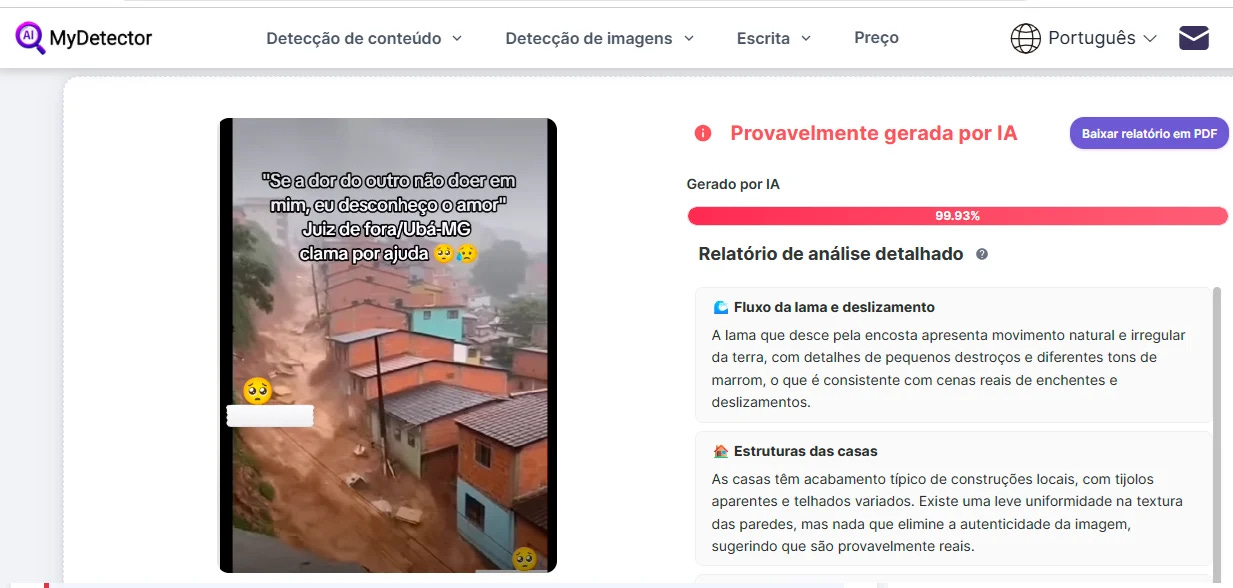

Nos últimos dias, por exemplo, viralizou um vídeo que supostamente mostra carros e casas arrastados pela enxurrada. A cena é impressionante: pontes cedem, veículos giram na correnteza, telhados são levados pela água. Acompanhando as imagens, está a mensagem: “Se a dor do outro não doer em mim, eu desconheço o amor. Juiz de Fora/Ubá-MG clama por ajuda”.

Tudo falso, como mostrou a minha colega Carol Mácario, que usou a ferramenta de detecção de IA MyDetector para comprovar a fraude.

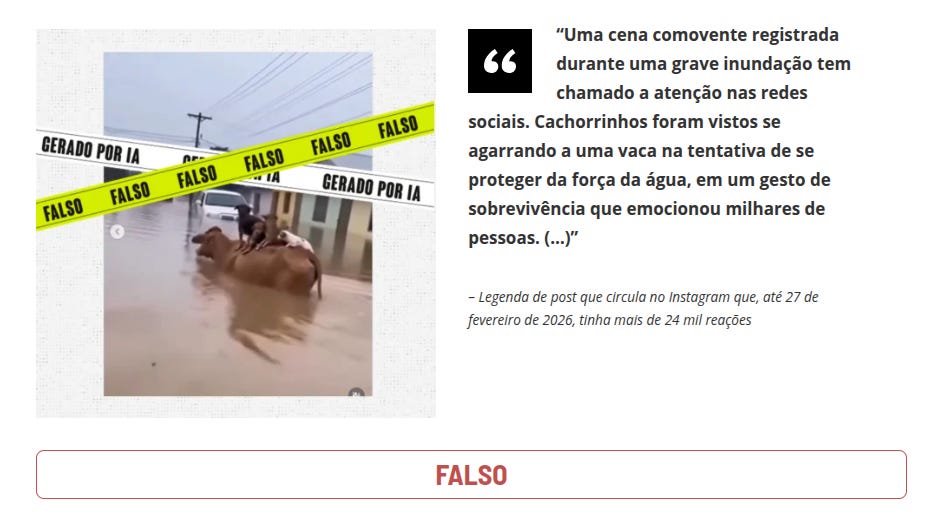

Em outro caso desmentido pela Lupa, o responsável pela publicação foi além: somou ao apelo catastrófico pitadas de ternura, compaixão e até um certo toque de imprevisibilidade.

Em um vídeo — inteiramente gerado por IA —, uma vaca aparece atravessando uma enchente, enquanto quatro cachorros pegam “carona” em suas costas para escapar da água. O resultado: mais de 24 mil reações no Instagram até 27 de fevereiro.

Essa prática não é adotada apenas no Brasil. Do outro lado do mundo, o conflito entre Estados Unidos e Israel contra o Irã também foi inflamado nas redes com táticas de engajamento enganosas.

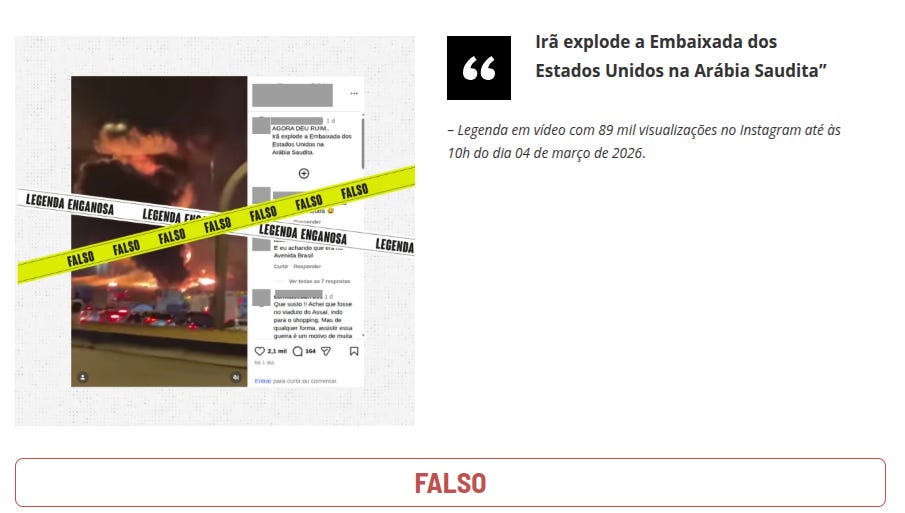

A guerra desencadeou uma enxurrada de vídeos fora de contexto, imagens antigas e conteúdos fabricados para capturar a atenção do público em meio ao caos informativo. Exemplo disso é um vídeo que, supostamente, mostraria o momento do ataque iraniano contra a embaixada dos Estados Unidos em Riad, capital da Arábia Saudita. O registro viralizou no Brasil e em outros países, como Índia e Emirados Árabes.

O ataque de fato aconteceu, mas as imagens virais não têm relação com o episódio. A gravação já circulava na internet desde fevereiro, semanas antes do ataque com drones registrado em 3 de março — que não deixou feridos e causou apenas danos leves na parte externa da representação dos EUA na capital saudita.

No fim das contas, muda o cenário, mas a engrenagem é a mesma: tragédias reais viram combustível para conteúdos enganosos que circulam rápido nas redes.

Para situações como essa, vale seguir algumas dicas reunidas por outro colega da Lupa, Victor Terra:

Desconfie de conteúdos muito emocionais ou dramáticos.

Posts feitos para chocar ou comover tendem a ser usados para viralizar rápido.Verifique quando e onde a imagem surgiu.

Muitos vídeos virais são antigos ou de outros lugares.Procure a fonte original ou veículos confiáveis.

Antes de compartilhar, veja se a informação foi confirmada por imprensa ou agências de checagem.Evite compartilhar no impulso.

Em cenários de desastre ou guerra, informação errada pode atrapalhar resgates, mobilizações e ajuda real.

Quase 3 milhões de crianças e adolescentes foram vítimas de exploração ou abuso sexual facilitados pela tecnologia em um ano. O dado integra o relatório Disrupting Harm in Brazil, lançado pelo Unicef Innocenti em parceria com a ECPAT International e a Interpol, com financiamento da Safe Online. Redes sociais, aplicativos de mensagens e jogos online estão entre os principais meios usados por agressores. Em 49% dos casos, o autor era alguém conhecido da vítima. Uma investigação da Lupa mostra que o problema também envolve as próprias plataformas. A repórter Gabriela Soares identificou ao menos 84 anúncios pagos no Facebook que prometiam conteúdo de pornografia infantil. As publicidades direcionavam usuários para grupos no Telegram, onde supostas imagens e vídeos eram vendidos por valores entre R$ 12,90 e R$ 44,90. [Evelin Mendes, editora]

O ChatGPT sofreu uma debandada de usuários nos Estados Unidos após vir à tona um acordo da OpenAI com o Departamento de Defesa — renomeado Departamento de Guerra pelo governo Trump. O acordo estabelece a prestação de serviços de inteligência artificial por parte da OpenAI para estratégias militares e de inteligência. Segundo a empresa de marketing Sensor Tower, o número de usuários que desistalaram o aplicativo no dia 28 de fevereiro cresceu 295% em relação ao dia anterior. O concorrente Claude, da Anthropic, teve aumento de 37% em instalações. A empresa se recusou a fechar acordo com o mesmo departamento, com a justificativa de não querer o uso da IA para vigilância ou arma de guerra. [Beatriz Farrugia, analista de pesquisa]

Conheça nossa política de privacidade.